随着AIGC(人工智能生成内容)工具的蓬勃发展,人们对人工智能算法中的偏见和歧视问题也越来越关注。这些工具依赖于训练数据,而这些数据中固有的偏见可能会传递到生成的内容中,从而延续和放大社会中的不平等现象。

偏见的根源

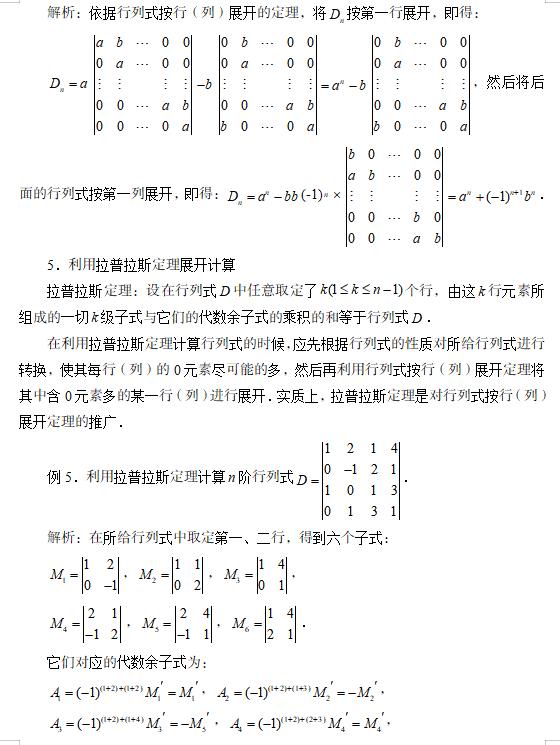

AIGC工具所依赖的数据通常来自互联网或其他公开来源,这些来源往往存在着各种形式的偏见:性别偏见: 女性在科技和领导力等领域普遍面临代表性不足的问题。数据反映了这一偏见,导致AIGC工具生成的内容中女性角色经常被边缘化或刻板化。种族偏见: 少数族裔在媒体和教育等领域经常面临负面刻板印象。这些偏见渗透到数据中,导致AIGC工具生成的内容中少数族裔角色可能被描绘成犯罪分子、帮派成员或其他负面形象。认知偏见: 人类认知的固有缺陷,如刻板印象和确认偏见,可能会导致数据中出现偏见。当AIGC工具从这些数据中学习时,它们会放大并复制这些偏见。

歧视的后果

当AIGC工具中存在偏见时,其生成的内容可能会对特定群体造成歧视性影响:招聘和求职: 使用带有性别或种族偏见的AIGC工具来审查简历或招聘申请人可能会导致歧视性决策,错失合格的候选人。医疗保健: AIGC工具在医疗保健领域的使用可能会加剧现有的医疗偏见,导致特定人群获得治疗或药物的机会不均。教育: AIGC工具在教育中的应用可能会强化刻板印象,导致某些群体在学习机会和成绩方面面临不公平待遇。

应对措施

为了减轻AIGC工具中的偏见和歧视问题,需要采取以下措施:数据审核: 仔细审查用于训练AIGC工具的数据,识别并移除有偏见或歧视性的内容。算法改进: 开发能够减轻偏见影响的算法,例如通过使用公平性指标或对敏感属性进行屏蔽。教育和意识: 提高AIGC工具开发人员和用户的意识,使其了解偏见的风险并采取措施减轻其影响。监管框架: 制定监管框架,要求AIGC工具提供商披露其算法的公平性措施并防止歧视性使用。

结论

AIGC工具的偏见和歧视问题是一个严重的担忧,需要立即关注。通过采取积极措施减少偏见的根源,改进算法,提高意识并建立监管框架,我们可以确保AIGC工具成为促进平等和包容的工具,而不是延续不公平现象的工具。

© 版权声明

文章版权归作者所有,未经允许请勿转载。