搜索引擎的收录过程是一个复杂且庞大的任务,面对互联网上无数的网页,需要专门的工具来筛选和索引。

以Google为例,虽然鲜有明确证实存在DeepBot和FreshBot的区别,但普遍认为,Google的robots中有一部分被称为FreshBot,它们的主要职责是持续扫描互联网,以构建庞大的URL列表,供DeepBot使用。

FreshBot在扫描时并非直接进行索引,而是寻找网页中的链接,这一过程可能看似效率不高,但可以通过观察不同数据中心的robots的访问行为来判断。

FreshBot记录的信息包括URL、时间戳以及网页头部信息(这存在争议,有人认为FreshBot不会读取网页内容,而是交给DeepBot处理)。

FreshBot会排除被禁止索引的网页,以提高效率。

鲜有频繁访问就代表索引的情况,可能是FreshBot在扫描URL。

FreshBot的记录优先级分为多种,如新建网页、更新的网页、重定向页面等,这些网页的优先级根据链接质量和来源有所不同。

索引完成后,DeepBot会根据优先级处理网页,包括动态URL和未更新的网页。

动态URL需要更多权威链接才能从补充结果中脱颖而出。

未更新的网页会与Google索引库中的时间进行比对,确保已索引最新版本。

404页面则会检查是否存在重复内容。

在此过程中,数据中心之间需要进行同步更新,这在GoogleDance更新后变得更加连续和实时。

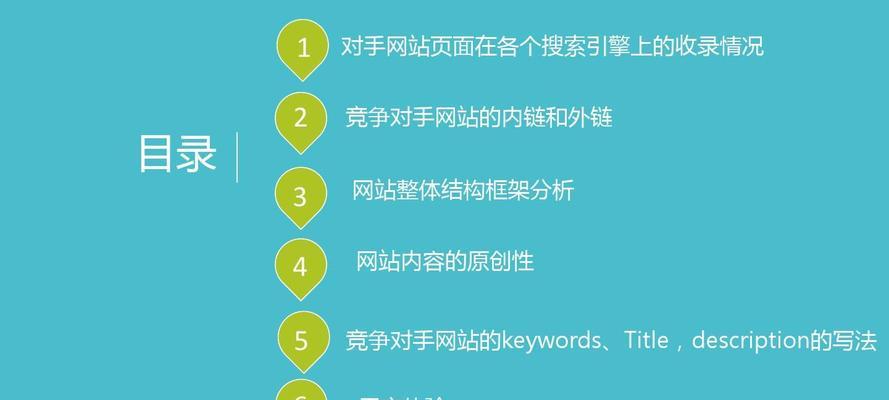

扩展资料

网站收录就是与互联网用户共享网址,网站收录前提是网站首页提交给搜索引擎,蜘蛛才会光顾,每次抓取网页时都会向索引中添加并更新新的网站,站长只需提供顶层网页即可,不必提交各个单独的网页。

抓取工具能够找到其他网页。

符合相关标准提交的网址,会在1个月内按搜索引擎收录标准被处理。

© 版权声明

文章版权归作者所有,未经允许请勿转载。